TLab — DevOps & SRE Lab

1 avril 2026

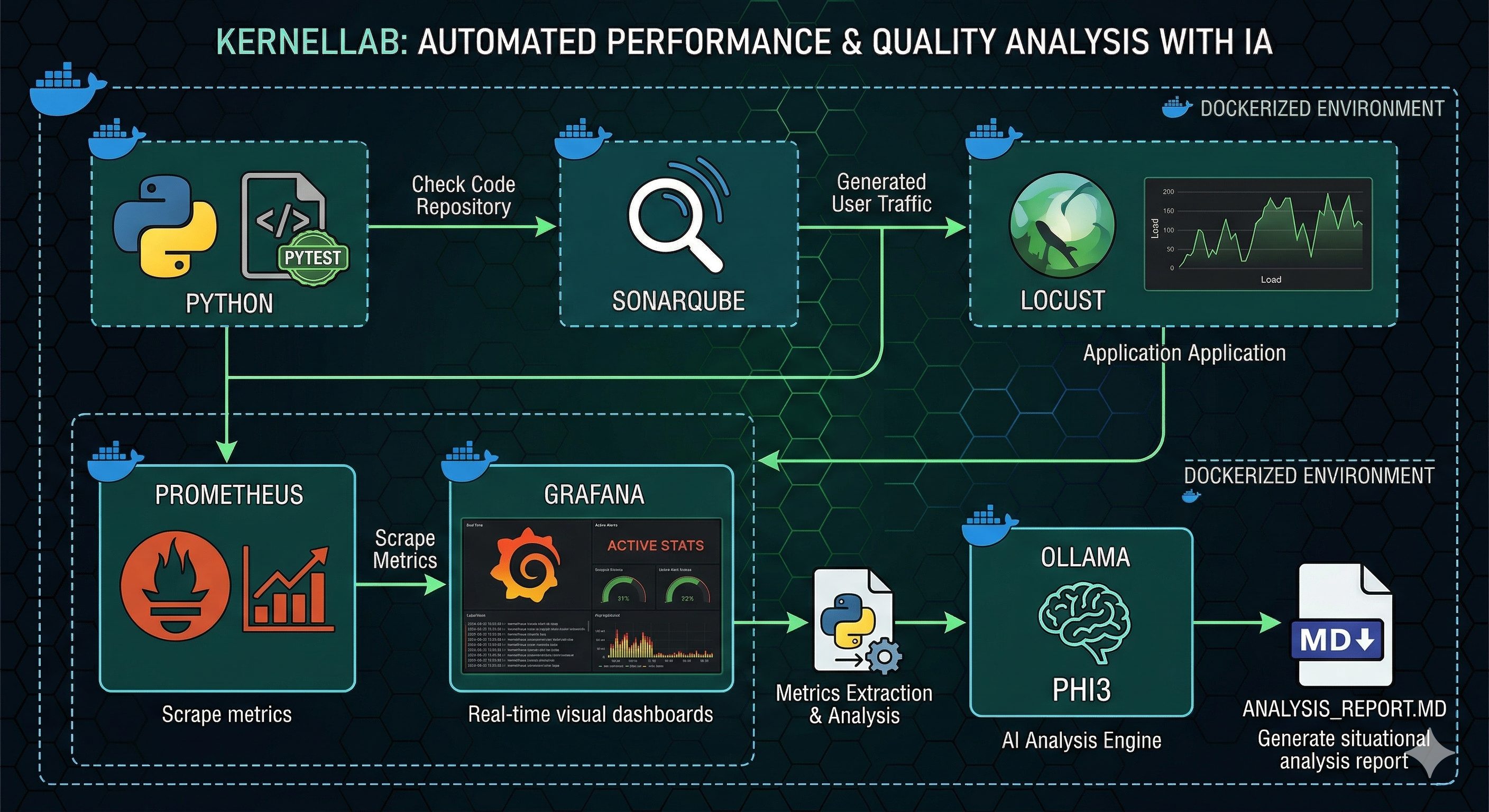

Un environnement de laboratoire complet pour expérimenter l’observabilité, les tests de charge et l’analyse de métriques assistée par une IA locale (Ollama).

1 avril 2026

TLab — Projet DevOps / SRE

Contexte

Afin d’améliorer mes compétences et d’apprendre les bonnes pratiques en DevOps et SRE, j’ai décidé d’explorer de nouveaux outils et technologies.

La meilleure façon d’apprendre étant de construire des projets concrets, j’ai créé cet environnement de laboratoire.

Le projet expose deux endpoints :

/health— permet de vérifier que l’application fonctionne et expose des métriques pour Prometheus/compute— permet d’exécuter des calculs intensifs et expose également des métriques pour Prometheus

L’objectif est de générer de la charge via un script Python et d’observer les métriques en temps réel avec Prometheus et Grafana.

Objectifs

- Apprendre et appliquer les bonnes pratiques DevOps et SRE

- Construire un projet fonctionnel et réaliste

- Explorer des outils comme Grafana, Prometheus, Locust et approfondir mes compétences en Python et FastAPI

- Enrichir le projet avec une IA locale pour générer des rapports sans dépendre de services externes

- Approfondir l’utilisation de GitLab CI et la gestion des artefacts

Stack technique

- Python — Langage de programmation

- Pytest — Framework de test

- FastAPI — Framework web

- Docker — Conteneurisation

- Ollama — IA locale (modèle Phi 3.5)

- Locust — Tests de charge

- GitLab — Gestion du code & CI

- Grafana — Visualisation des métriques

- Prometheus — Collecte et monitoring des métriques

Architecture

L’ensemble du projet est conteneurisé et orchestré avec Docker Compose.

Il est composé des services suivants :

- FastAPI

/health— endpoint de vérification/compute— endpoint de calcul intensif

- Ollama — IA locale utilisée pour générer des rapports

- Grafana — dashboard de visualisation

- Prometheus — collecte des métriques

- GitLab CI — exécution des tests et génération des artefacts

Ce que j’ai appris

- Amélioration de mes compétences en Python et FastAPI

- Mise en place de tests automatisés dans un pipeline GitLab CI avec gestion des artefacts

- Utilisation d’une IA locale (Ollama avec le modèle Phi 3.5) pour générer des rapports